هوش مصنوعی

-

مجله ورزشی

تحولات هوش مصنوعی در سال ۲۰۲۵؛ چشماندازی از آیندهای سرشار از تغییرات

فاطمه مرادخانی: هوش مصنوعی در حال تبدیل شدن به یکی از تاثیرگذارترین فناوریها در قرن ۲۱ است و به سرعت در حال تغییر صنایع مختلف و جوامع جهانی میباشد. پیشبینیها نشان میدهند که این فناوری تا سال ۲۰۳۰ میتواند ۱۹.۹ تریلیون دلار به اقتصاد جهانی اضافه کند و ۳.۵ درصد از تولید ناخالص داخلی (GDP) را تشکیل دهد. یکی از نمونههای بارز این تحولات، پروژه “پروژه استارگیت” است که سرمایهگذاری عظیمی به مبلغ ۱۰۰ میلیارد دلار برای ساخت مراکز داده هوش مصنوعی جدید را در بر میگیرد. یکی از چالشهای اصلی در دنیای امروز هوش مصنوعی، تفکیک سیگنال از نویز است؛ بهطوری که سرعت پیشرفتهای فناوری و گسترش آن در صنایع مختلف باعث دشوار شدن درک صحیح روندها و ارزیابی اهمیت آنها میشود. برای حل این مشکل، بسیاری از کارشناسان به جای اتکا به تحلیلگران انسانی، به خود هوش مصنوعی رجوع میکنند تا نظرات دقیقی در مورد روندهای پیشرو دریافت کنند. مدل o1 از شرکت اپن ایآی یکی از این ابزارها است که توانسته است با تحلیل دقیق روندهای مختلف هوش مصنوعی، لیستی از مهمترین روندهای سال ۲۰۲۵ را ارائه دهد. این روندها بر اساس معیارهایی همچون پتانسیل تجاریسازی، توانایی ایجاد تغییرات بنیادین در صنایع و تاثیرات اجتماعی ارزیابی شدهاند. …

-

اقتصادی

ورود هوش مصنوعی به سیاست خارجی

چنین تغییر شکلی دنیای کسبوکار و روابط ژئوپلیتیکی را متحول خواهد کرد. هوش مصنوعی به عنوان ابزاری جدید که هنوز بسیاری از وجوه آن ناشناخته است، به هر حوزهای که ورود کند میتواند حساسیتهایی را برانگیزد و نگرانیهای را ایجاد کند، اما شاید حساسترین حوزهای که بیم آن میرود مضرات هوش مصنوعی در آن بیش از مزایایش باشد، عرصه سیاست است. یکی از این حوزههای جدید، عرصه سیاست خارجی و روابط بین الملل است؛ هوش مصنوعی با قابلیت تحلیل کلان دادهها و پیشبینی رویدادها و تحولات، در حال تبدیل شدن به یک تغییر دهنده جدی صحنه بازی در روابط بین الملل است. در نتیجه برخی کشورهای پیشرو در زمینه هوش مصنوعی به استفاده گسترده از این فناوری نوظهور در جهت تحلیل و تصمیمگیری در عرصه سیاست خارجی روی آوردهاند. بخش امور امنیت خارجی در وزارت امور خارجه چین یکی از پیشروترین نهادهای وزارت خارجه در جهان است که از سیستمهای هوش مصنوعی برای تحلیل و تصمیمگیری در مورد مسائل پیش روی خود استفاده میکند؛ به عنوان مثال، این نهاد در فرایند تصمیمگیری برای سرمایهگذاری خارجی در رابطه با طرح ابتکاری «یک کمربند – یک جاده» با ریسک بالای سیاسی، اقتصادی و زیست محیطی، از هوش مصنوعی استفاده کرده است. ایالات …

-

اقتصادی

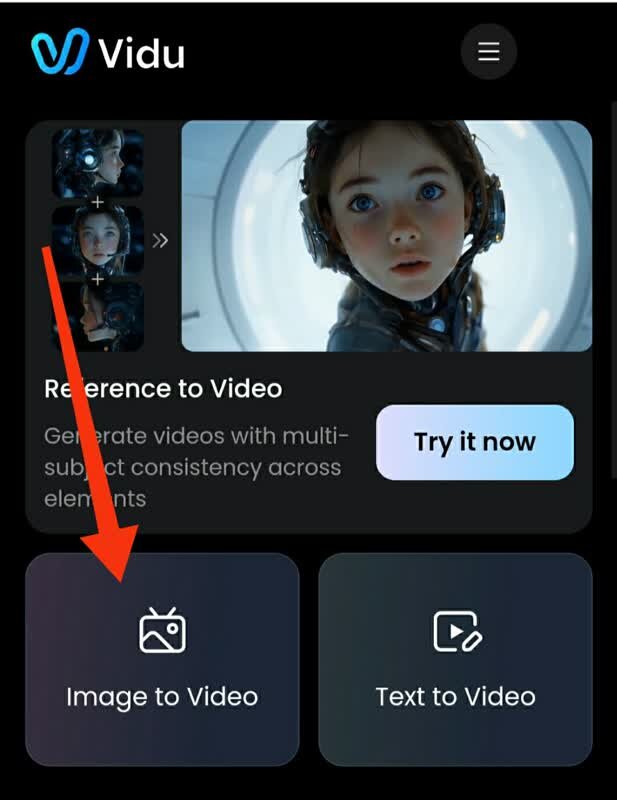

نحوه استفاده از یک هوش مصنوعی جذاب که حاشیه آفرین است!

سوال او این بود؛این ها واقعی است؟! خُب مشخصا پاسخ این است که خیر واقعی نیست و با هوش مصنوعی ساخته شده این را حالا دیگر خیلی ها می دانند حتی اگر فیلم و عکسی واقعی هم باشد باز به آن شک می کنند که البته این شک خوب است. چون در بحث راستی آزمایی اخبار، شک کردن به محتوا، یکی از اصول اولیه و بسیار لازم است. به صورت ویژه اما مدتی است در آغوش گرفتن دو نفر با هم سوژه شده و هر بار با فیلمی روبرو می شویم که دو نفرِ خاص، همدیگر را دوستانه در آغوش می گیرند. این کار به راحتی و با استفاده از یک سایت هوش مصنوعی انجام می شود. روش کار با آن هم ساده است. کافی است به این سایت هوش مصنوعی (http://vidu.studio) مراجعه کنید. برای استفاده از این سایت دو راه دارید یا عضو آن شوید یا از طریق حساب گوگل(جیمیل) خود وارد شوید. پس از ورود در بخشی که در تصویر می بیند یک عکس دو نفره وارد می کنید و منتظر می مانید تا پس از چند دقیقه این سایت، تصویر دو نفره ای که در آن آپلود کرده اید را کاملا طبیعی به صورت یک فیلم حرفه ای …

-

مجله عمومی

هوش مصنوعی و تاثیر آن در سیاست خارجی

هوش مصنوعی به عنوان ابزاری جدید که هنوز بسیاری از وجوه آن ناشناخته است، به هر حوزهای که ورود کند میتواند حساسیتهایی را برانگیزد و نگرانیهای را ایجاد کند، اما شاید حساسترین حوزهای که بیم آن میرود مضرات هوش مصنوعی در آن بیش از مزایایش باشد، عرصه سیاست است. تا کنون سیاستمداران و پژوهشگران سیاسی بسیاری در مورد توسعه روزافزون و بیقاعده هوش مصنوعی هشدار داده و خطراتی را برای ورود آن به سیاست ترسیم کردهاند. «هنری کیسینجر»، وزیر اسبق امور خارجه آمریکا، از آن دسته پژوهشگرانی بود که دید مثبتی نسبت به ورود هوش مصنوعی به سیاست نداشت. او بر این اعتقاد بود در شرایطی که احتمال جنگ چین و آمریکا وجود دارد، هوش مصنوعی میتواند به یک تسلیحات دیجیتالی در دست قدرتهای بزرگ تبدیل شود؛ سلاحی که به اعتقاد کیسینجر از بمب اتم هم مخربتر خواهد بود، زیرا هیچ گونه تفکر و شعور انسانی پشت آن وجود ندارد. جهان سیاست، مانند بازی شطرنج است که مبتنی بر ارزیابی سناریوها و پیشبینی بهترین واکنش یا بهترین حرکت مهرهها است؛ اما شطرنج جهان سیاست، پیچیدگی بیشتری دارد؛ بهنحویکه بازیگران زیادی با ترجیحات آشکار و نهان در آن شرکت دارند که رویکردهای اعلامی و اعمالی آنها بهضرورت یکسان نیست؛ تغییرات …

-

مجله عمومی

غول هوش مصنوعی ! – مجله رز

اگر به گذشته و دهه های قبل بر گردیم و این دکان های صوری را بیاد بیاوریم بی شمار خواهند بود ولیکن مطمئن هستم همه در ذهنمان حداقل چند تای آخری را بیاد داریم، واکسن کرونا، دستگاه شناسایی کرونا، آینده پژوهی، کرسی های نظریه پردازی، مسکن های ملی، خودرو ملی، پوشش اسلامی ایرانی و … آنقدر زیاد که حیف است وقت را برای لیست کردن آنها تلف کنیم. در اخبار و در همین راستا، اینروزها می بینم که از بزرگ و کوچک، روحانی و غیر روحانی، تحصیلکرده و غیر تحصیلکرده و تقریبا پیر و جوان درباره هوش مصنوعی صحبت می کنند. این قسمت کار عالیست ولیکن بشرطی که این فناوری و قابلیت های آنرا درست فهمیده باشیم یا حداقل مقدمات آنرا یا حتی یک تعریف کلی از آنرا بدانیم ! بر این اساس چند روز پیش خبری دیدم در خصوص اینکه هوش مصنوعی کمک شایانی به اسلامی سازی دانشگاه ها خواهد کرد ! یا از این نوع صحبت ها ! همان مد و ژست انتلکچوال که در بالا عرض کردم. بنظر حقیر تمامی این مسائل از آنجا شروع می شود که ما برای کشور یک برنامه کوتاه، میان و طولانی مدت محکم نداریم که بر اساس آن آهسته آهسته ولیکن …

-

اقتصادی

هوش مصنوعی چگونه بلایای طبیعی را پیشبینی میکند؟

هوش مصنوعی به ابزاری قدرتمند در بهبود توانایی انسان در پیشبینی وقوع بلایای طبیعی تبدیل شده است که به کاهش تلفات انسانی و مادی و بهبود واکنش اضطراری کمک میکند. به گزارش مجله رز، به نقل از ایتنا، هوش مصنوعی به ابزاری قدرتمند در بهبود توانایی انسان در پیشبینی وقوع بلایای طبیعی تبدیل شده است که به کاهش تلفات انسانی و مادی و بهبود واکنش اضطراری کمک میکند. استفاده از تکنیکهای هوش مصنوعی در این زمینه به تجزیه و تحلیل دادههای بزرگ و پیچیدهای بستگی دارد که پردازش آنها دشوار است تا دقت پیشبینیها از طریق یادگیری ماشینی و شبکههای عصبی عمیق بهبود یابد. برخی از کاربردهای اصلی هوش مصنوعی در این زمینه عبارتند از: پیشبینی زمین لرزه: اگرچه زلزلهها بلایای طبیعی محسوب میشوند که پیشبینی آنها دشوار است، هوش مصنوعی میتواند با تجزیه و تحلیل دادههای زمینشناسی از لرزهسنجهای پراکنده در سراسر زمین برای کشف الگوهایی که ممکن است نشاندهنده وقوع زلزلهای در آینده باشد، به بهبود درک ما از الگوهای زلزله کمک کند. اگرچه هنوز پیشبینی اولیه زلزله در مراحل ابتدایی است، اما استفاده از هوش مصنوعی میتواند دقت این پیشبینیها را در بلندمدت بهبود بخشد. پیش بینی سیل: سیل در اثر باران شدید یا آب شدن برف ایجاد میشود و میتواند …

-

اقتصادی

هوش مصنوعی و ترورهای اسرائیل

از رمزگشایی پیچیده کدهای انیگما گرفته تا عملیات جاسوسی، در همه موارد از تکنیکهای پیچیدهای برای جمعآوری اطلاعات، رمزنگاری و رمزگشایی اطلاعات استفاده شده است، با اینحال، تمامی این روشها در گذر زمان تغییر پیدا کردهاند. بهطوری که فناوریها، ابزارهای ردیابی، تحلیل و مقابله با تهدیدات نیز تکامل پیدا کردهاند. فایلهای رمزگذاری پیچیده، جایگزین پیامهای رادیویی رمزگذاری شدند، بهطوری که امروزه شکستن پیامهای رمزنگاری شده یا گذر از لایههای امنیتی سختتر از هر زمان دیگری شده است. با این حال، هنوز هم نقطه ضعف مکانیزمهای امنیتی خطای انسانی است. برای بسیاری، عدم درک مقیاس و تعیین میزان خطرناک بودن یک تهدید بالقوه، عدم درک یا تفسیری از جرایم سایبری و نحوه عملکرد آنها و به دنبال آن عدم اطمینان از امنیت دادهها و اطلاعات اولین اشتباهی است که مرتکب میشوند و راه را برای نفوذ هکرها به زیرساختها هموار میکنند. اگر تصور میکنید همه نقاط ضعف احتمالی که باعث آسیبپذیری زیرساخت میشوند را ترمیم کردهاید، باید بدانید که این دیدگاه اشتباه است و ممکن است حفرههای امنیتی زیادی مستتر در زیرساخت ارتباطی باشند که از دید شما پنهان باقی ماندهاند. به همین دلیل است که شرکتها تصمیم گرفتند برای کاهش مخاطرات پیرامون زیرساختهای ارتباطی به سراغ هوش سایبری بروند. هوش …

-

مجله علمی و پزشکی

برای درک شوخیهای ایلان ماسک هوش مصنوعی لازم است

به گزارش مجله رز، شبکه اجتماعی ایکس(X) متعلق به ثروتمندترین مرد جهان، ایلان ماسک، از مدل هوش مصنوعی «گروک» میزبانی میکند و به تازگی یک بهروزرسانی دریافت کرده است که با آن به توانایی درک تصاویر تجهیز شده است. به نقل از مجله رز، ایلان ماسک «گروک» را در حال توضیح یک لطیفه در یک پست در ایکس به نمایش گذاشت و اشاره کرد که این فناوری هنوز در مراحل اولیه است. وی با اعلام این خبر در یک توییت نوشت: «گروک» اکنون تصاویر را درک میکند، حتی معنای یک لطیفه را توضیح میدهد. این یک نسخه اولیه است. به سرعت بهبود خواهد یافت. به غیر از این، نه خود ماسک و نه شرکت توسعه دهنده «گروک» موسوم به ایکسایآی(xAI) توضیح بیشتری ارائه ندادند. ایلان ماسک مالک شرکت xAI است، شرکتی که عملکرد درک تصویر «گروک» را تقویت میکند. اکنون میتوان برای توضیح شوخیهای تصویری که ایلان ماسک اغلب از آنها استفاده میکند و برای بسیاری نامفهوم است، از «گروک» کمک گرفت و خوشبختانه برای خواندن توضیحات «گروک» به خرید اشتراک نسخه پریمیوم ایکس نیازی نیست. همانطور که انتظار میرود، تواناییهای درک تصویر «گروک» هنوز در مقایسه با چتجیپیتی(ChatGPT) پایینتر است، زیرا توضیح شوخی توسط آن تا حدودی نامفهوم است، …

-

مجله علمی و پزشکی

سرمایهگذاری کلان عربستان برای تبدیل شدن به یک ابر قدرت هوش مصنوعی

به گزارش مجله رز، عربستان اخیرا با برگزاری رویداد Leap به نام «به سوی آینده» بار دیگر سرمایهگذاری هنگفت خود را در حوزه هوش مصنوعی به نمایش گذاشت. در این همایش افراد مهمی از جمله آدام سلیپسکی، مدیر اجرایی بخش محاسبات ابری آمازون حضور داشتند که از سرمایه گذاری ۵.۳ میلیارد دلاری در عربستان سعودی برای مراکز داده و فناوری هوش مصنوعی خبر داد. معاملات میلیارد دلاری در رویداد هوش مصنوعی عربستان بر اساس گزارش پیوست، آرویند کریشنا، مدیر اجرایی آیبیام (IBM)، از موضوعی صحبت کرد که آن را «دوستی مادامالعمر» با پادشاهی خواند. مدیران هواوی و دهها شرکت دیگر در این رویداد از اجرای برنامههای آینده خود در نقشه راهبردی هوش مصنوعی عربستان سخنرانی کردند. به گفته آژانس مطبوعاتی دولتی عربستان سعودی، بیش از ۱۰ میلیارد دلار معامله در این حوزه انجام شده است. شو چو، مدیر اجرایی TikTok در این همایش گفت: عربستان کشور بزرگی است و ما انتظار داریم بیشتر از آنچه معین شده در عربستان سرمایهگذاری کنیم. پادشاهی عربستان بهدنبال تبدیل شدن به یک بازیکن برتر در هوش مصنوعی است و مبالغ چشمگیری را برای این کار هزینه میکند. عربستان امسال یک صندوق ۱۰۰ میلیارد دلاری برای سرمایهگذاری در AI ایجاد کرد. علاوه بر این، آنها در …

-

مجله علمی و پزشکی

مردی که با هوش مصنوعی ۱۰ میلیون دلار پول به جیب زد!

به گزارش خبرگزاری مجله رز و براساس گزارش دیجیاتو، مردی آمریکایی بهخاطر ساخت گروههای موسیقی و آهنگهای جعلی با هوش مصنوعی و استفاده از بات برای افزایش تعداد پخش این آهنگها و کسب میلیونها دلار درآمد غیرقانونی دستگیر شد. وزارت دادگستری ایالات متحده در بیانیه مطبوعاتی خود توضیح میدهد که مردی ۵۶ ساله از کارولینای شمالی با نام «مایکل اسمیت» به انجام طرحی ظاهراً هفتساله متهم شده که در آن از مهارتهایش در موسیقی بهشکل غیرمجاز برای بیش از ۱۰ میلیون دلارکسب درآمد استفاده کرده است. این مرد درمجموع به ۳ اتهام پولشویی و کلاهبرداری متهم شده است و ممکن است برای هر اتهام خود به حداکثر ۲۰ سال زندان محکوم شود. اسمیت ظاهراً با همکاری ۲ همدست ناشناس خود (یک مبلّغ موسیقی و یک مدیرعامل شرکت ساخت موسیقی با هوش مصنوعی) «صدها هزار آهنگ» تولید کرده است و برای افزایش دفعات پخش آهنگها نیز از شیوههای متقلبانه استفاده کرده است. نحوه ساخت آهنگ و کسب درآمد با هوش مصنوعی وزارت دادگستری در بیانیه خود میگوید در نام آهنگهایی که این مدیرعامل به اسمیت ارائه کرده، اعداد و حروف تصادفی قرار داشتند، مانند «n_۷a۲b۲d۷۴-۱۶۲۱-۴۳۸۵-۸۹۵d-b۱e۴af۷۸d۸۶۰.mp۳». سپس هنگام آپلود آنها در پلتفرمهایی مانند آمازون موزیک، اپل موزیک و اسپاتیفای، اسمیت نام آنها را به مواردی مانند «Zygotic» تغییر …